Немецкие ученые убеждены: беспилотный транспорт способен принимать решения, основываясь на нравственном выборе. Иными словами, есть возможность смоделировать человеческую мораль и привить ее машине.

Исследователи Института когнитивных наук при Оснабрюкском университете провели эксперимент, в ходе которого участникам было предложено вести машину по туманным улицам виртуальной реальности. Неожиданно водитель попадал в ситуацию, когда следовало быстро принять решение – свернуть в сторону людей, животных либо направить транспорт на неодушевленный объект.

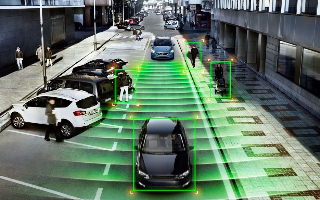

Обработка статистики показала, что решения водителей легко поддаются объяснению, их можно превратить в модель. Ранее считалось, что нравственный выбор зависим от контекста, поэтому якобы нереально прописать для него алгоритмы. Однако ученые обнаружили обратное: жизненные ценности в затруднительной ситуации умещаются в довольно простую модель. Такой же выбор по силам делать и транспорту.

По мнению исследователей, теперь необходимо на общественном уровне обсудить вопрос, касающийся наделения автономных систем моральными суждениями людей, определить — какие именно этические теории следует закладывать в программу. И главный вопрос – если что-то пойдет не так, кто будет нести ответственность?

К примеру, как система будет квалифицировать выбежавшего на дорогу ребенка, создающего опасность для пассажиров? Будет ли он приоритетней, чем стоящий на тротуаре взрослый? Любые системы искусственного интеллекта (ИИ) нуждаются в четко прописанных правилах. В противном случае они способны изобрести собственные, без участия человека.

Специалисты все чаще задумываются о проблемах этики в связи с развитием ИИ. В конце минувшего года институтом IEEE обнародованы результаты дискуссий сотни экспертов, обсуждавших вопросы обучения машинного интеллекта нравственным постулатам. В январе 2017-го группа филантропов в тандеме со специалистами ИТ-сферы создали специальный фонд, который призван внести в процесс разработки ИИ тему общечеловеческих ценностей и морали.